엔비디아의 750만원짜리 미니 슈퍼컴퓨터? AI 무한으로 돌려봤습니다 ㅋㅋ

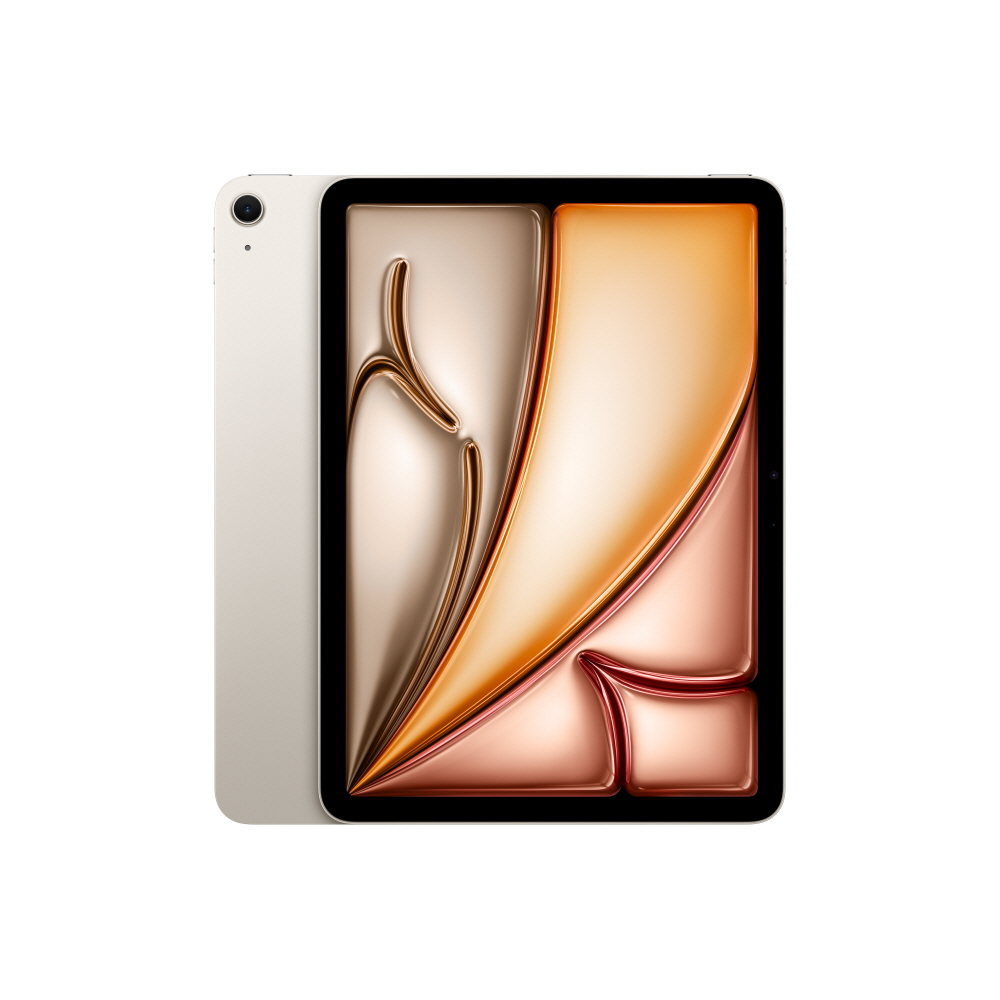

작년 10월이었나요? 일명 깐부치킨 회동이 있었을 때 젠슨황이 이재용, 정의선 회장에게 선물해서 큰 이슈를 모았던 제품, 바로 DGX Spark라는 슈퍼컴퓨터를 엔비디아에서 하나 보내주셨습니다. AI 툴을 어느정도 다뤄봤지만 전문가까진 아니라고 해도, 나름대로 몇 달간 열심히 써보면서 느낀 점을 영상으로 만들어 봤습니다! 🔗 Sponsor. -본 영상의 제품은 '엔비디아'에서 제품만 제공받았습니다. 🔋 Specs. 제품명 : DGX Spark 프로세서 : NVIDIA GB10 Grace Blackwell …...

@김수호-v8c 812

2026년 2월 9일 8:00 오후ai 잇섭 폼 미쳤다 ㅋㅋㅋㅋㅋㅋㅋㅋㅋㅋ

@windowsxpbot1551 793

2026년 2월 9일 8:07 오후혹시 신사적인 것도 테스트 하셨나요?

@pizzaaaaaaaa-j9w 561

2026년 2월 9일 8:01 오후이야 이제 로컬 ai를 잔뜩 돌리실려나?

@김동진_kdj..123 329

2026년 2월 9일 8:07 오후유구한 전통...

지뢰찾기 ON

@UCe1myrBIoHjE8xnifXGqUbA 316

2026년 2월 9일 8:37 오후13:09 오버피팅 문제는 흔히 말하는 '연습 문제만 잘 푸는 아이'가 되어 버린 것과 같습니다. 오버피팅이라는 게 모델을 학습시키는 데 사용한 데이터는 한정적인데 이 한정적인 문제를 계속 학습시키다 보니 그 작은 학습자료가 곧 세상의 전부가 되어버리고, 모든 문제에 대해 학습한 데이터만 답으로 내놓는 깡통이 되어버리는 거죠. 이럴 땐 학습 데이터를 더 추가하거나, 학습량을 줄이는 식으로 이것저것 돌려봐야 합니다.

@라뚜 253

2026년 2월 9일 8:01 오후예???? DGX를 제공받았다구요..? 이건 진짜 부럽네

@m2c-z2c 119

2026년 2월 9일 8:58 오후지나가던 인공지능 공부하는 대학생이자 교수님 노예입니다

파인튠 관련해서 조언하나 해드리면 지금 생성된 결과로 봤을때 ai가 문맥적인 특징을 전혀 파악하지 못하고 있는것으로 보입니다

학습 시킬때 데이터를 어떤 형태로 주입시키셨는지는 모르겠지만 단순하게 용어집으로된 데이터로 넣으셨다면 ai는 그 용어가 어떤 의미인지 파악하는것 보다 단순하게 다음에 올 단어만 예측하는 꼴이 되어버립니다 데이터 넣으실때 문맥적 의미가 있는 문장형태로 넣으시면 학습 시키는데 도움이 될것 같습니다. 그리고 제가 엑사원은 코드를 뜯어보거나 학습 시켜본 경험이 없어서 자세히는 모르지만 학습 시킬때 train loss와 validation loss라는 것이 있습니다

모델은 이 loss 값들이 낮을수록 좋습니다 loss 종류에 따라 다를수는 있지만 1.5 미만은 떨어져야 어느정도 의미있는 모델이 되었다고 얘기합니다(모델 성능과는 별개의 의미 입니다) 여기서 학습 시킬때 epoch이라는 단위 또는 step이라는 단위로 해당 loss 값들을 산출하는데 학습 과정을 거치며 점차 0으로 수렴하는 양상을 보여야 정상입니다. 그런데 여기서 오버피팅이라는 개념이 나오는데 모델이 학습하면서 지나치게 학습 데이터에 익숙해져 학습 데이터를 이해보다 암기에 가까운 상태에 이르는 것을 말합니다.

이럴때는 train loss는 거의 0에 수렴하지만 validation loss 값이 train loss의 반비례로 높아지게 됩니다.

이 현상을 막기 위해서는 데이터에 조금씩 변형을 주는 데이터 변환 기법들을 사용하기도 하는데 제가 자연어 모델 전공은 아니라 그런 기법에 대해서는 직접 찾아보시거나 gpt한테 물어 보면 알려줄겁니다

내용이 많이 어려우실텐데 장황한 조언 읽어 주셔서 감사합니다 위에 설명한 내용 말고도 학습에 관여하는 수많은 설정값들이나 기법이 있습니다.

사실상 전공자가 아닌이상 이걸 이해하기에는 많은 시간이 걸릴텐데 일반인 입장에서 모델 파인튠은 말처럼 그리 간단한 작업이 아닙니다. 파인튠 도전해보시면 좋겠지만 안하시는게 정신 건강에 도움이 되실겁니다

그럼 마저 지나가겠습니다....

dgx는 부럽네요.. 저도 하나만...

@모르겠구리 89

2026년 2월 9일 8:21 오후catastrophic forgetting: 인공지능이 새로운 정보를 학습하기 시작하면 그 이전에 학습한 것들을 매우 빠르게 까먹어버림.

LG 연구원 분들이 깎아놓은 똑똑한 지식들을 잇섭님이 파인튜닝하면서 엑사원이 전부 까먹어버린 거라고 이해하시면 돼요.

잇섭님이 시도하신 것보다 아주 조금만 학습시켜서(데이터의 수를 줄인다 X. 학습률을 낮추거나 학습 횟수를 낮춘다 O.) 이전의 똑똑한 지식들을 까먹지 않도록 하시면 조금 나을 거에요.

@곰큐 79

2026년 2월 9일 10:58 오후7:05 즐겨찾기에 Open-LLM-Vtuber…

@avatarwarmech3367 78

2026년 2월 9일 9:03 오후2:42 저거 그거 아님? 목욕탕 같은데 가면 있을법한 그 발바닥 각질 갈갈갈하는 돌덩어리같은거 ㅋㅋ

@YeongjongKim 66

2026년 2월 9일 10:32 오후파인튜닝은 원래 모델이 가지고 있는 능력을 헤칠 위험이 많은 어려운 작업이라서 요즘은 파인튜닝처럼 추가 학습을 하지 않고 원하는 지식 데이터베이스를 참고해서 AI가 답변을 하게 만드는 RAG (Retrieval-Augmented Generation)이라는 기법을 많이 씁니다!

@김재원-n4t6s 57

2026년 2월 14일 7:10 오후이걸로 오픈클로 돌리는거 영상찍으면 대박일듯요ㅋㅋㅋ

@엘비엘비 52

2026년 2월 9일 8:15 오후깐부회동때 이재용회장,정의선회장이 받았던 그 슈퍼컴 ㄷㄷㄷㄷ

@aegis721 48

2026년 2월 9일 8:32 오후Open claw 셋업하는 영상도 부탁 드립니다.

@haru__ 39

2026년 2월 9일 8:46 오후exaone 이 finetuning시 한국어를 잘 안먹습니다.

qwen3 같은 모델로 시도 해보시는걸 추천드려요.

@glasscannon0524 36

2026년 2월 9일 8:41 오후나름 업계 종사자가 봐도 나름 이해가 잘 되게 설명하신거 보니 비전공자이신 잇섭님이 시간내서 열심히 공부하신 느낌이 드네요. 관련 전공자나 현업자분 도움 받으면 금방하실거 같아요

@anonymity5090 35

2026년 2월 9일 8:10 오후Ai섭 ㅋㅋㅋㅋㅋㅋㅋㅋㅋㅋㅋㅋㅋㅋ

@성연-z5h 29

2026년 2월 9일 8:05 오후나중에 휴머노이드 로봇에 spark 슬롯있어서 권장사양으로 2개씩 꼽으라고 하는거 아님? ㅋㅋㅋ

@SMH-b2i 26

2026년 2월 9일 8:08 오후ai 잇섭 미쳣나바 ㅋㅋㅋㅋㅋㅋㅋㅋㅋㅋㅋ

@factorial_ 23

2026년 2월 9일 8:09 오후ai까지 손대는 서울 야스킹 폼 미쳤다

@JunsuHan-y1w 20

2026년 2월 9일 8:34 오후AI 파인튜닝에는 데이터셋이 정말 방대하게 필요해요.

데이터의 다양성이 부족하고, 양이 부족하면 과적합이 됩니다.

즉, 지금은 데이터를 더 늘려보시는 쪽으로 시도하셔야합니다!

사람으로 비유하면 사과 = apple을 이미 알지만 계속 반복 학습시키는 것과 비슷합니다.

이런 경우 모델은 학습 데이터만 암기하게 되는거죠. 이게 과적합니다.

@워터밤양갱 18

2026년 2월 9일 8:03 오후AI 인트로 폼 미쳤다 ㅋㅋㅋㅋㅋ😊😊😊😊

젠슨황의 설날선물이네요.

@Retis1 18

2026년 2월 9일 11:08 오후13:02 LLM 식 조현병 ㅋㅋㅋ

@JSY-t6w 16

2026년 2월 9일 8:01 오후오! 영상 주기가 엄청 빨라진 것 같아요!

@silvercloud8917 16

2026년 2월 9일 9:16 오후과적합을 푸는 방법은 다양합니다. 데이터를 늘리거나 학습 과정을 줄이거나 또는 loss back propagation을 할 때 어려운 케이스만 추려서 학습하는 등.. 여러 방법이 있습니다. 또는 데이터를 준비하는 단계에서 너무 양이 적다면 그 데이터를 원본삼아 변조해서 데이터의 양을 늘리는 방법이 있고, 잘 학습된 모델의 전체 파라미터를 망가뜨리지 않고 쓰고싶다고 하면 full fine tuning이 아니라 LoRA (low rank adaption) 또는 shallow depth parameter tuning 을 통한 파라미터 일부 학습이 효과적입니다.

@habea3238 13

2026년 2월 9일 8:03 오후ai와 함께라면 초 슬림 잇섭도 가능할까?

@팡팡팡나초 12

2026년 2월 9일 8:38 오후실험장비(?)라고 생각하면 또 싸기도 하네여 ㅋㅋㅋㅋㅋ 신기하다

@anonymity5090 12

2026년 2월 9일 8:15 오후11:27 맥섭 미쳤다 ㅋㅋㅋㅋ

@지민_이 11

2026년 2월 9일 10:25 오후이제 헤체쇼 가야겠지..?

@CTubeYouBaL 10

2026년 2월 9일 8:25 오후메모리 대역폭은 딱 m4 pro랑 동급이네요 ㅋㅋ

맥에서 oss 20b 잘 쓰고있는데 출력 속도도 비슷할지 궁금한

@예전중앙처리장치 9

2026년 2월 9일 8:02 오후잇섭의 다잇섭이 진짜 다 AI까지 있다는 뜻이였네요

@엥-m9d 9

2026년 2월 9일 9:20 오후14:10 혹시 오픈클로 영상도 올리실 건가요? 엄청 궁금하던데 잇섭님이 일반인 입장에서 실사용 하는 영상이 모고 싶어요

@123Q2D3 9

2026년 2월 9일 8:30 오후14:07 local llm 붙인 openclaw 머신 추천드립니다..제가 하고싶네요

@Dystimic 9

2026년 2월 9일 8:02 오후2:50 이걸 어떻게 참습니까

12:10 이건 되게 신기하더라구여

@천세진-q7j 9

2026년 2월 9일 8:07 오후도금된 부분에 지문 다 묻히는거 킹받네 ㅋㅋ

@요아시카 8

2026년 2월 9일 8:26 오후맥스튜디오와 비교했음 어땠을지 궁금하네요

@RIRA00 8

2026년 2월 9일 9:11 오후저거 깐부치킨때만해도 500얼마였는데 이제 750이야? ㅎㅎ 미쳤다.

@daumssi.01 8

2026년 2월 9일 9:43 오후저걸 그냥 받으시네ㄷㄷ 이거 우리연구실에서 넉달 걸려서 받았는데

@Motion-i1u 7

2026년 2월 9일 10:52 오후목소리는 무슨 AI쓰신거에요 대박자연스럽네

@1212HHH 7

2026년 2월 9일 9:08 오후ㅋㅋㅋ 미쳣네요... 약 600만원 가량이면 개인이 로컬로 미니pc급 크기로 llm 120b를 돌리는 시대가 오다니..

컴피같은걸로 이미지 / 영상 뽑으시는분들은 무조건사겠네 저거..

@Cjlnsjslxl 6

2026년 2월 9일 8:19 오후0:53 블랙월?? 당장 넷워치 불러야겟네

@Retis1 6

2026년 2월 9일 11:03 오후120b 모델 속도 꽤 괜찮게 나오네 ㄷㄷ 모델 학습용으로 쓰기엔 메모리 때문에 뭐하긴 한데 추론용으로 쓰기엔 딱 좋긴 하겠다 ㅋㅋㅋ 가격이 ㅈㄴ 사악하긴 한데 그래도 로컬에서 120b 이상이 돌아가는게 어디야

@오리동전 5

2026년 2월 10일 4:26 오전램값을 올려버린 주범이 저기에 박혀있구만

@놀고싶은다미dami 5

2026년 2월 9일 8:00 오후와 750만원..ㄷㄷ

@kimjang_ 5

2026년 2월 9일 8:18 오후Spark를 쓰는 이유는 VRAM을 크게 하여 더 높은 사이즈 모델을 한 번에 그래픽 메모리로 적재할 수 있기 때문이죠. 5090에 GPT OSS 120B를 올리면 VRAM 공간이 부족해서 나머지는 일반 DRAM에 올리는데, 이러면 GPU 연산을 제대로 못 해서 CPU 로드로 넘어갑니다. 즉, GPU 성능을 내지 못하고 CPU로 AI 연산을 해버리게 되죠. 그래서 엄청 느려지죠.

그래서 고용량 통합 메모리로 AI 추론을 돌리려는 분들이 맥 스튜디오 512GB 같은 모델을 사서 추론 돌려 쓰려 하죠.

추론으로 쓰면 그게 더 가성비거든요. 학습용은 비추하고요.

그나마 Spark가 NVIDIA CUDA 기반이라 비록 머신깡 성능이 낮지만 저 정도 용량 모델을 파인튜닝하거나 할 만하죠.

@hyunw00761 4

2026년 2월 9일 10:09 오후우와우.. AI슈퍼컴퓨터 선물 받으시다니.. 행복하시겠어요~

@jensooonyengh1525 4

2026년 2월 9일 9:09 오후AI 전공 중인 학생입니다. 비유가 진짜 정확해서 이해가 슝슝 잘됩니다. 감사합니다.

@이재훈-b1y8p 4

2026년 2월 9일 8:04 오후미쳤다 진짜로 잇섭춤 거의 아이돌급

@hilllilill 4

2026년 2월 9일 8:27 오후잇섭님 다음편은 ai 슈퍼컴으로 게임 돌려 봅시다

@중립-x6t 4

2026년 2월 9일 8:08 오후가격이 좀 비싸긴하지만 집에 하나씩 있으면 좋긴하겠네요